前言

因heartbeat v1内置的资源管理器haresource功能比较简单,且不支持图形化管理,所以heartbeat v2不再支持haresource,转而使用更加强大的资源管理器crm进行集群管理。本文将讲解如何基于heartbeat v2 crm实现基于nfs的mysql高可用集群。

高可用实现

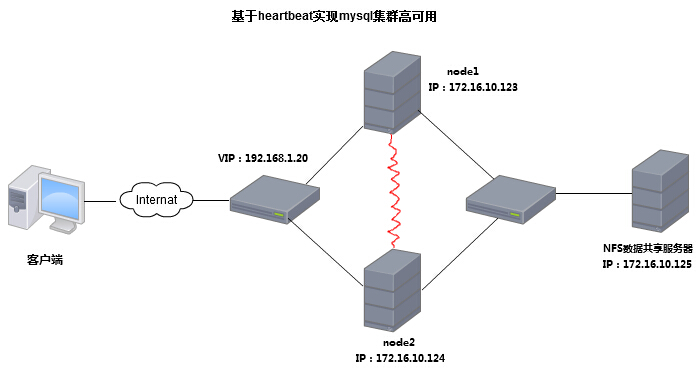

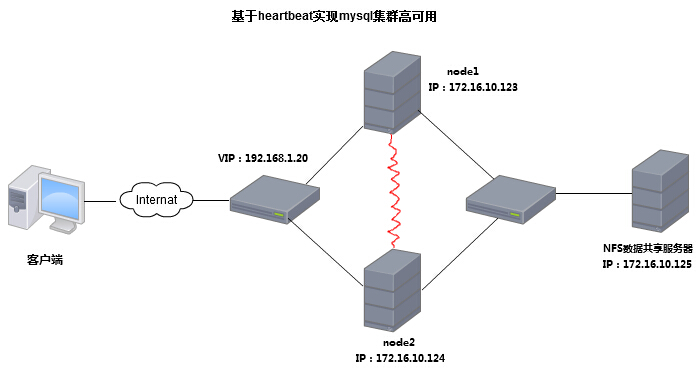

实验拓扑

实验环境

node1:172.16.10.123 mariadb-5.5.36 CentOS6.6

node2:172.16.10.124 mariadb-5.5.36 CentOS6.6

NFS:172.16.10.125 CentOS6.6

Windows环境需安装Xmanager Enterprise 5

配置过程

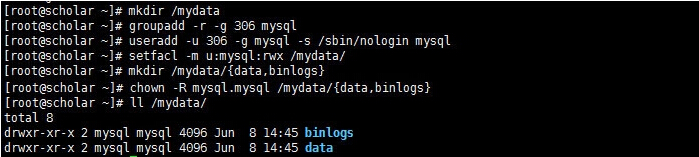

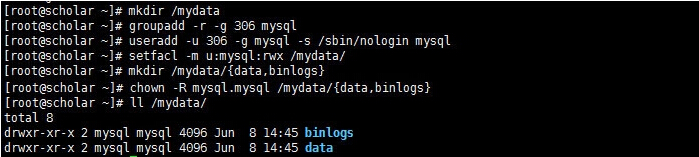

NFS服务器配置

[root@scholar ~]

/mydata 172.16.0.0/16(rw,no_root_squash)

[root@scholar ~]

|

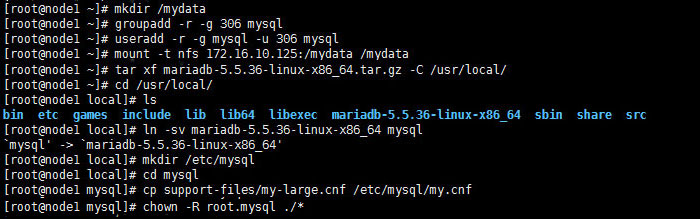

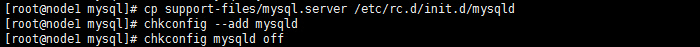

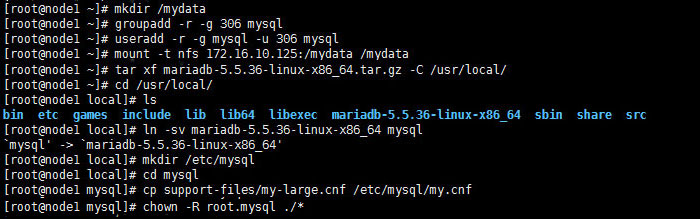

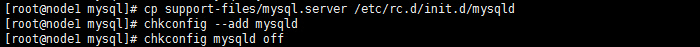

安装mysql

[root@node1 mysql]

datadir = /mydata/data

log-bin=/mydata/binlogs/master-bin

|

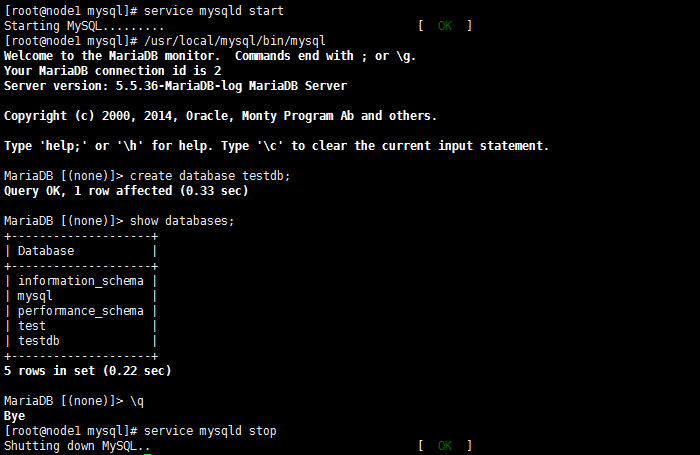

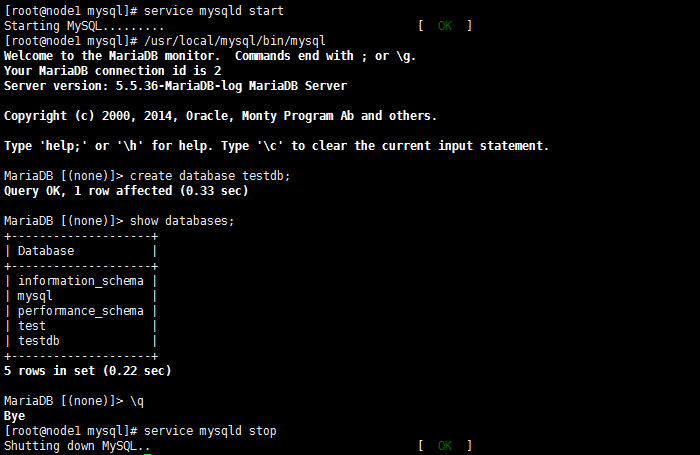

启动服务测试一下

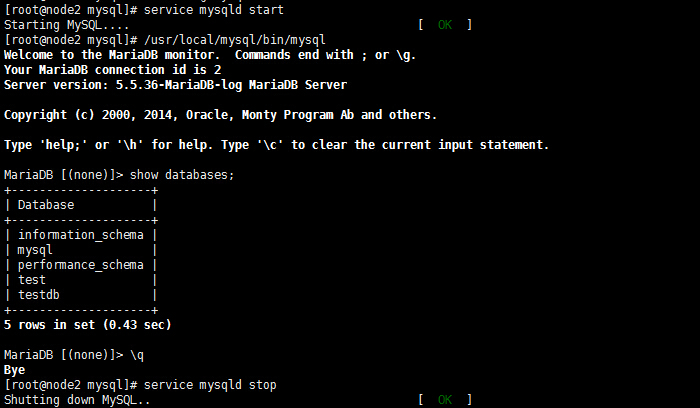

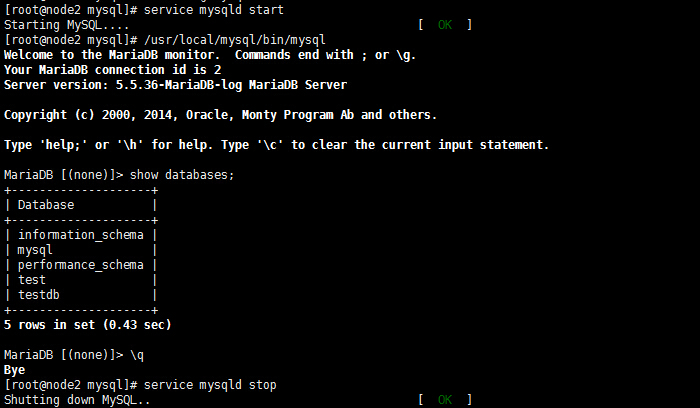

同样node2上执行以上操作后也启动测试

测试完成即可卸载共享目录

安全起见,此时可将nfs的no_root_squash选项去掉

[root@scholar ~]

/mydata 172.16.0.0/16(rw)

[root@scholar ~]

exporting 172.16.0.0/16:/mydata

|

heartbeat配置

时间同步

ntpdate

节点解析通信

[root@node1 ~]

172.16.10.123 node1.scholar.com node1

172.16.10.124 node2.scholar.com node2

[root@node1 ~]

HOSTNAME=node1.scholar.com

[root@node1 ~]

node1.scholar.com

|

ssh密钥配置

[root@node1 ~]

[root@node1 ~]

[root@node2 ~]

[root@node2 ~]

[root@node1 ~]

Mon Jun 8 16:33:36 CST 2015

Mon Jun 8 16:33:36 CST 2015

|

安装所需软件包

[root@node1 ~]

[root@node1 ~]

[root@node1 heartbeat2]

heartbeat-2.1.4-12.el6.x86_64.rpm heartbeat-pils-2.1.4-12.el6.x86_64.rpm

heartbeat-gui-2.1.4-12.el6.x86_64.rpm heartbeat-stonith-2.1.4-12.el6.x86_64.rpm

heartbeat-ldirectord-2.1.4-12.el6.x86_64.rpm

[root@node1 heartbeat2]

12.el6.x86_64.rpm heartbeat-stonith-2.1.4-12.el6.x86_64.rpm heartbeat-gui-2.1.4-12.el6.x8

6_64.rpm

|

准备配置文件

[root@node1 ~]

[root@node1 ~]

|

配置算法密钥

[root@node1 ~]

4d8fd6cb49d2047b

[root@node1 ~]

auth 2

2 sha1 4d8fd6cb49d2047b

|

配置主配置文件

[root@node1 ~]

logfile /var/log/ha-log

keepalive 2

deadtime 30

warntime 10

initdead 120

udpport 694

mcast eth0 225.0.25.1 694 1 0

auto_failback on

node node1.scholar.com

node node2.scholar.com

ping 172.16.0.1

crm on

|

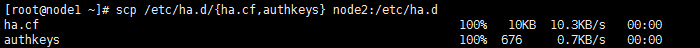

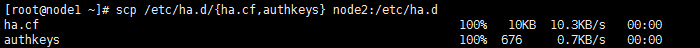

将配置文件传给备用节点

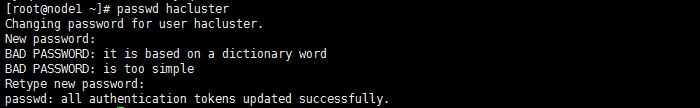

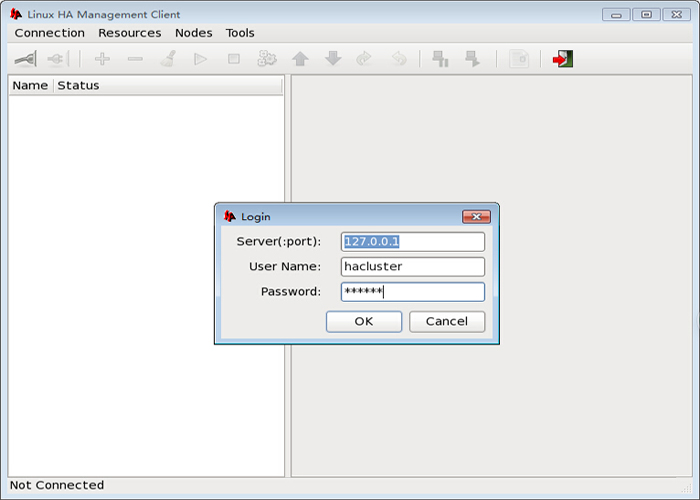

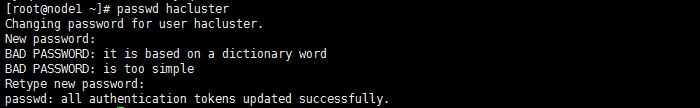

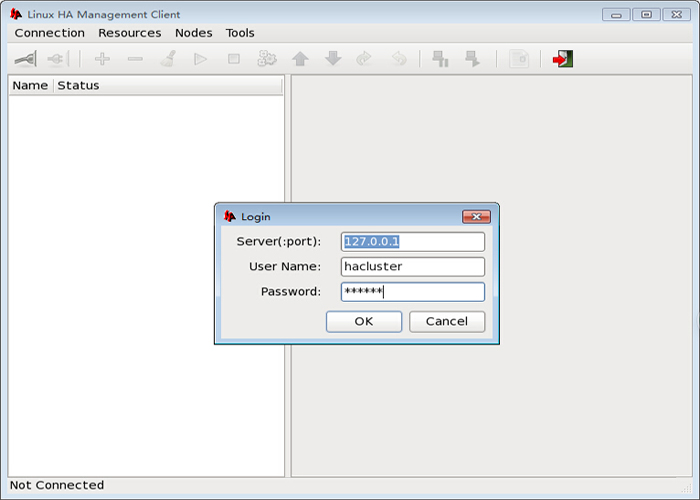

启用crm图形界面时需要登录密码,在安装heartbeat-gui时会自动创建一个名为hacluster的用户,在任一节点上设置hacluster的密码即可

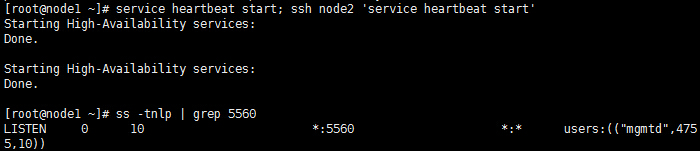

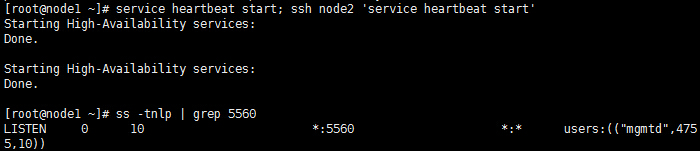

启动heartbeat

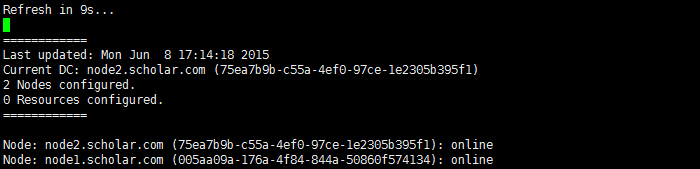

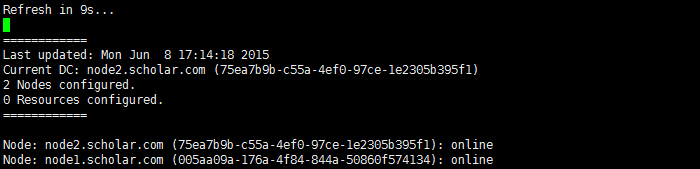

查看集群状态

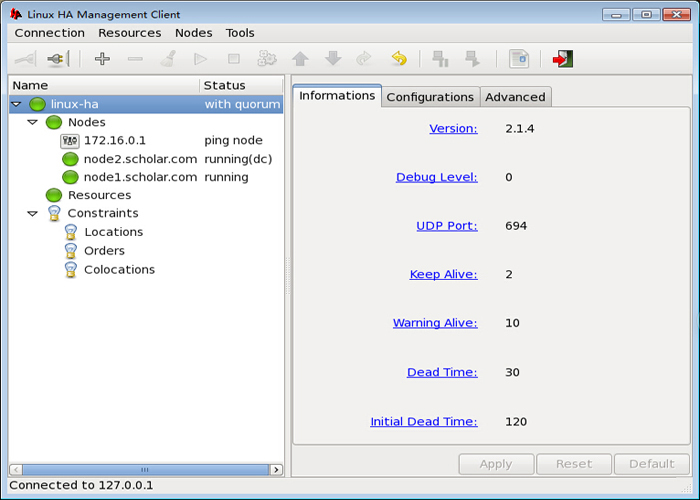

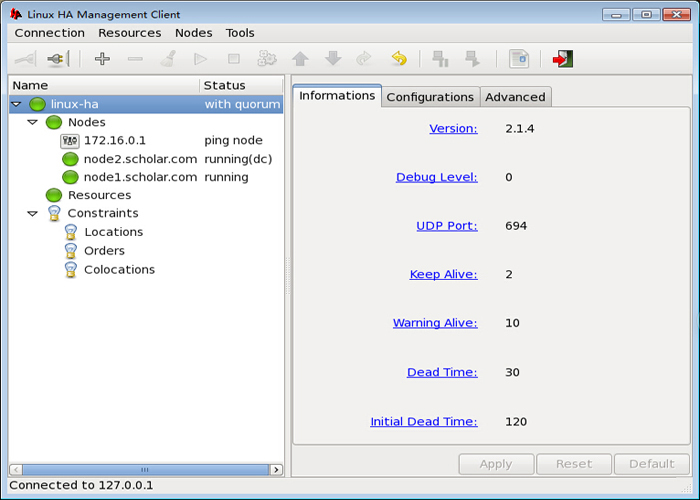

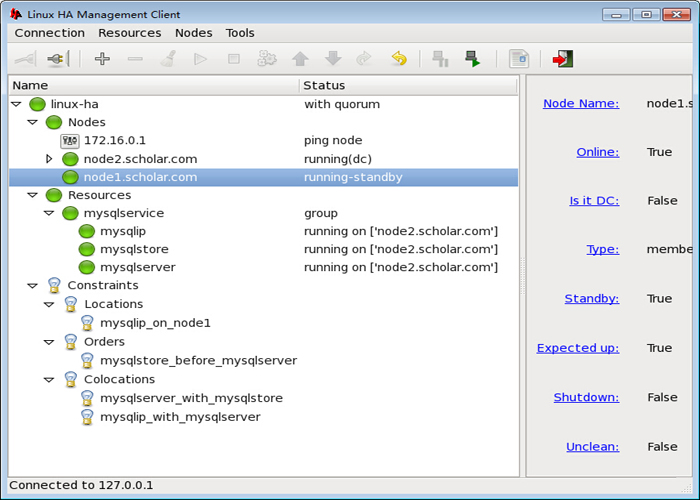

启动gui界面

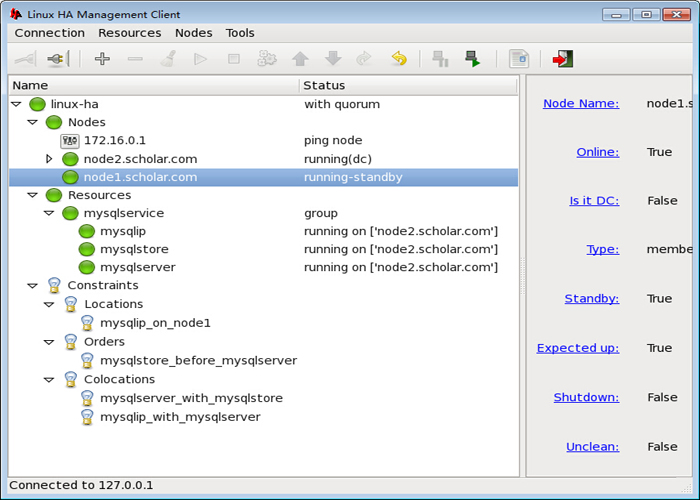

Node:节点列表

Resources:资源列表

Constraints:限制约束

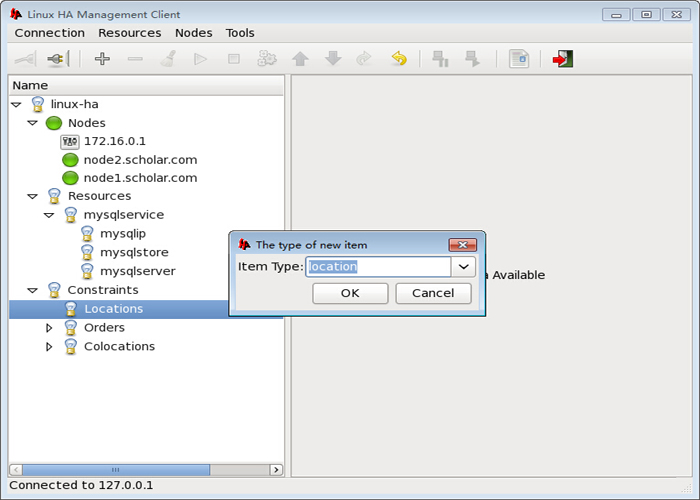

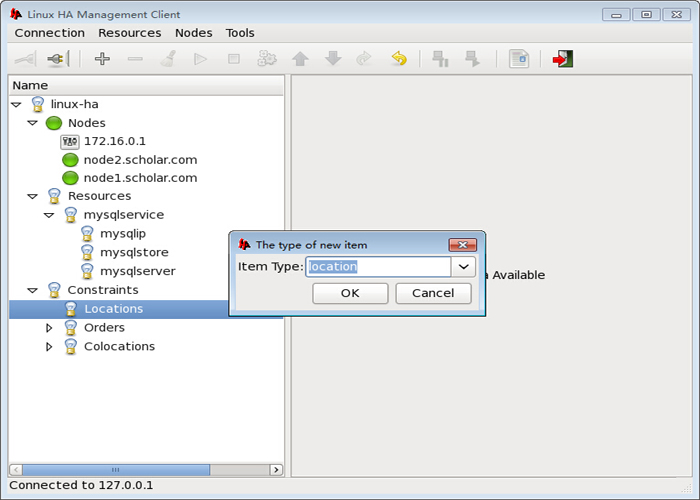

Locations:位置约束,资源对某节点运行的倾向性

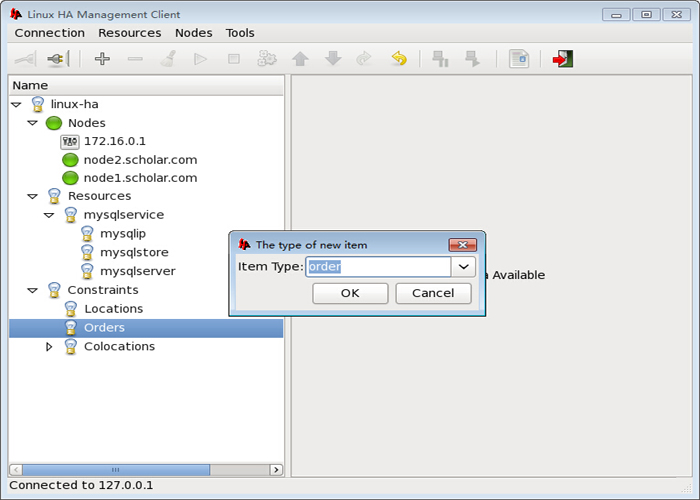

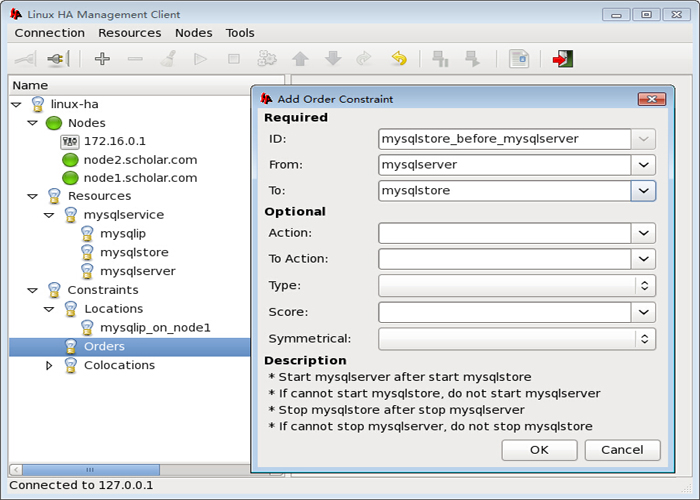

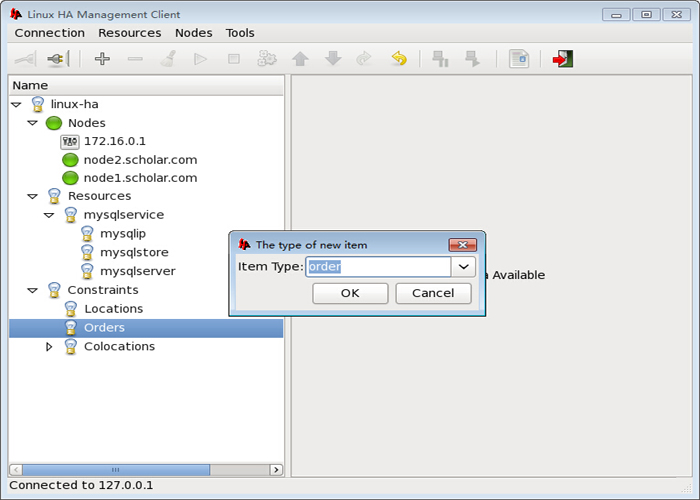

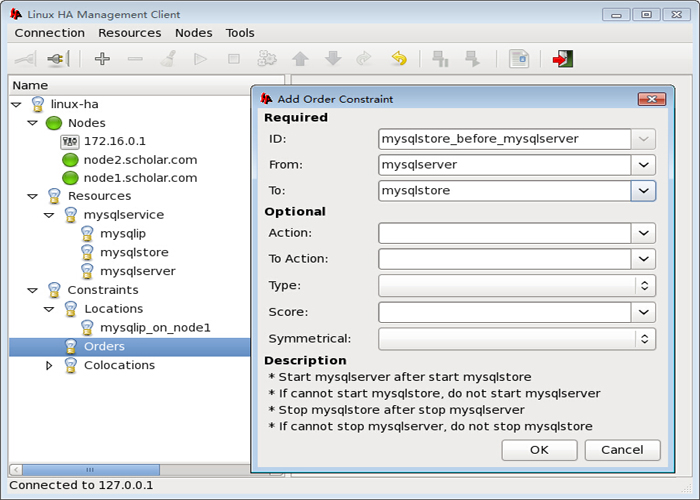

Orders:顺序约束,属于同一服务的多个资源运行在同一节点时,其启动及关闭的次序约束

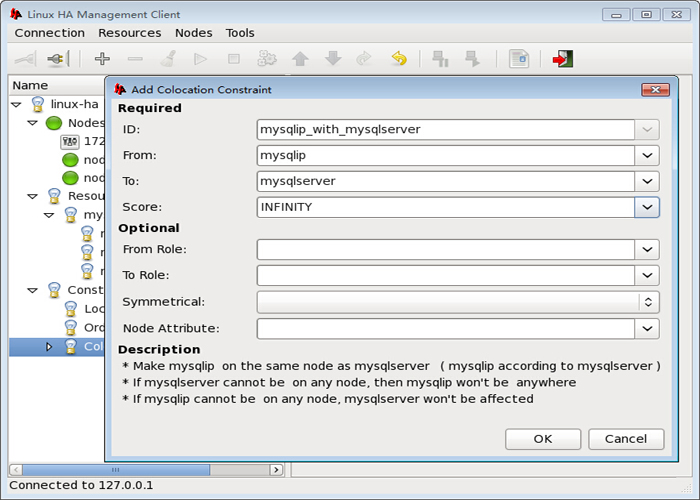

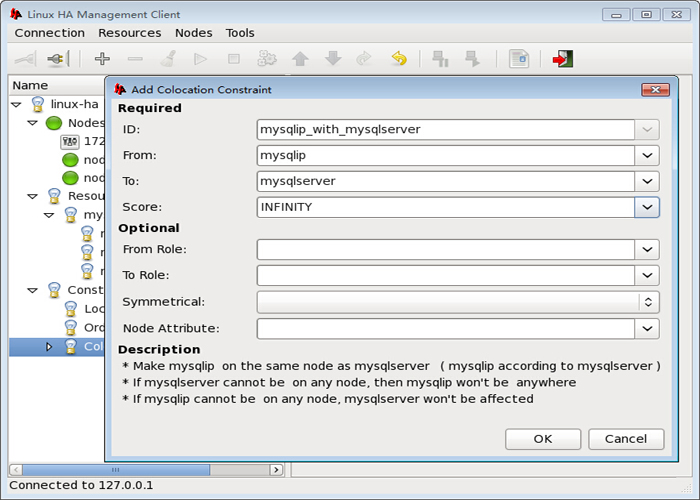

Colocations:排列约束,定义资源彼此间的倾向性(是否在一起)

|

资源类型:

primitive, native: 主资源,其仅能运行某一节点

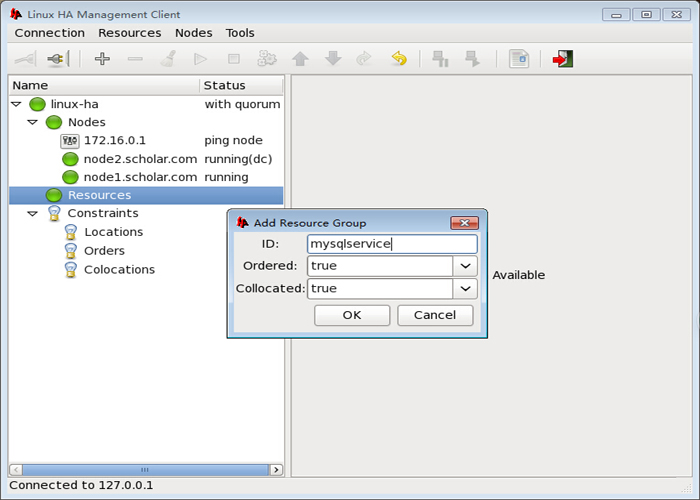

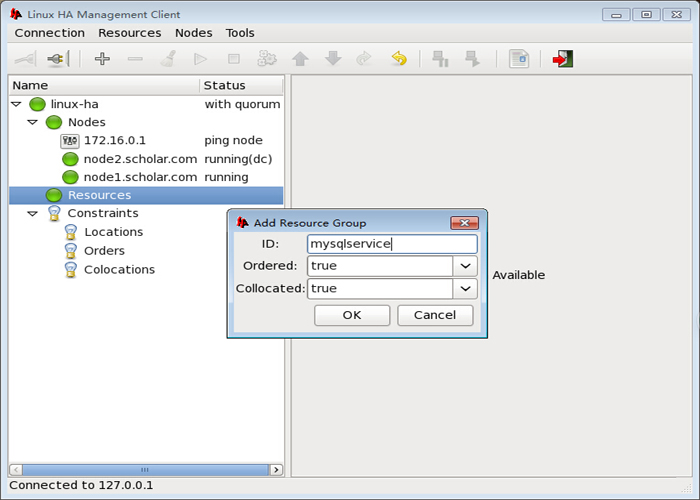

group: 组资源,可用于实现限制多个资源运行于同一节点及对此些资源统一进行管理

clone: 克隆资源,一个资源可以运行于多个节点

应该指定:最大克隆的份数,每个节点最多可以运行的克隆

master/slave: 主从资源,特殊的克隆资源

|

mysql的高可用需要3个资源:ip,mysqld,nfs,这3个资源都要运行在一个节点 上,而且mysqld要在nfs启动之后出能启动,ip地址和mysqld服务之间没有先后关系,服务准备好后再启动ip也是可以的。高可用的httpd 服务需要先启动ip,因为服务启动的时候明确需要ip地址的资源,这两类高可用资源之间是不同的。

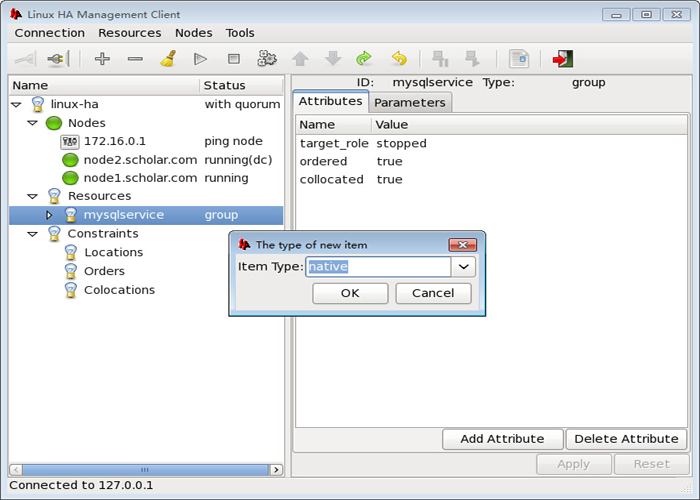

添加资源

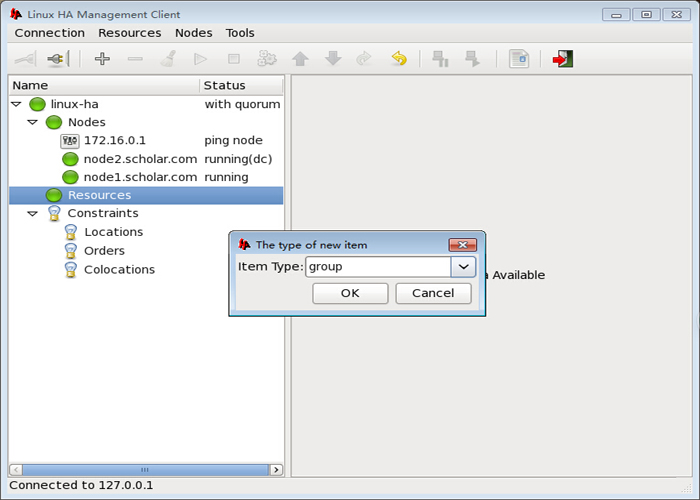

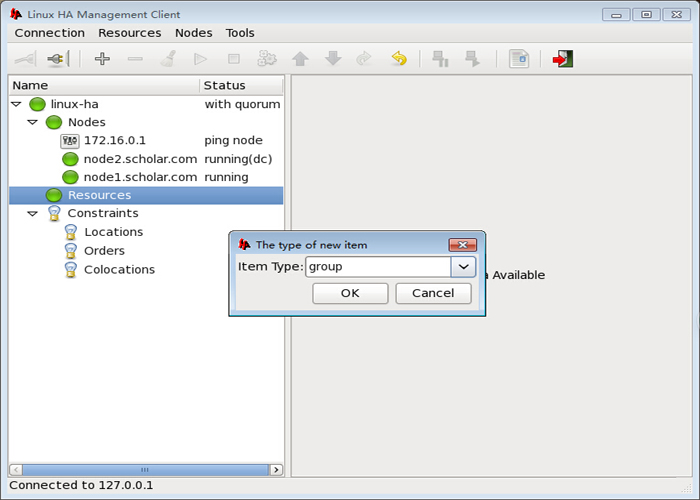

首先定义一个组

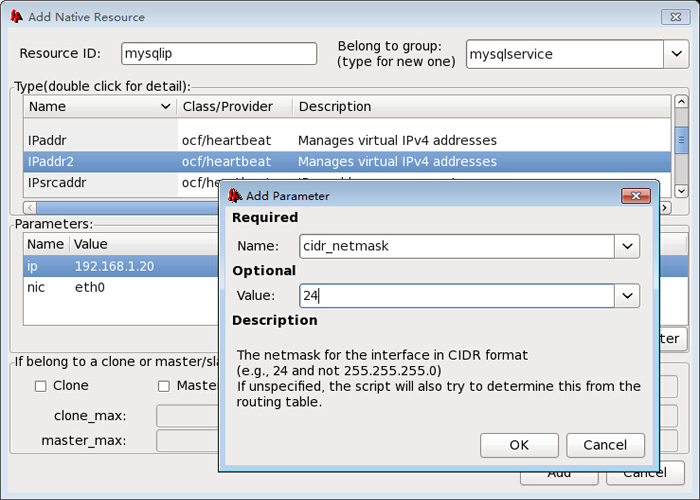

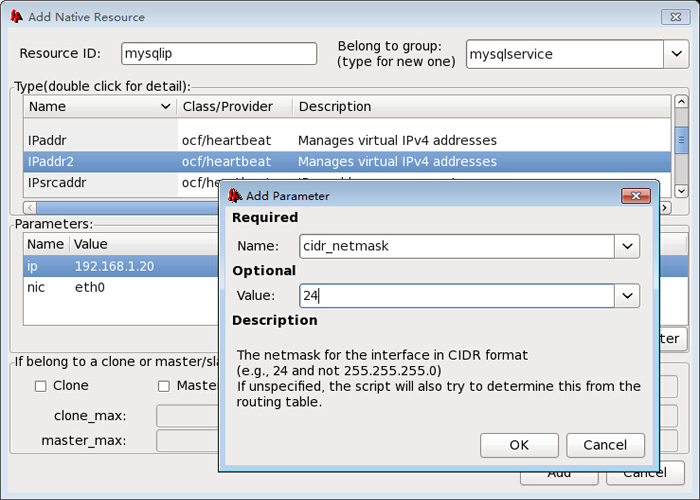

添加第一个资源

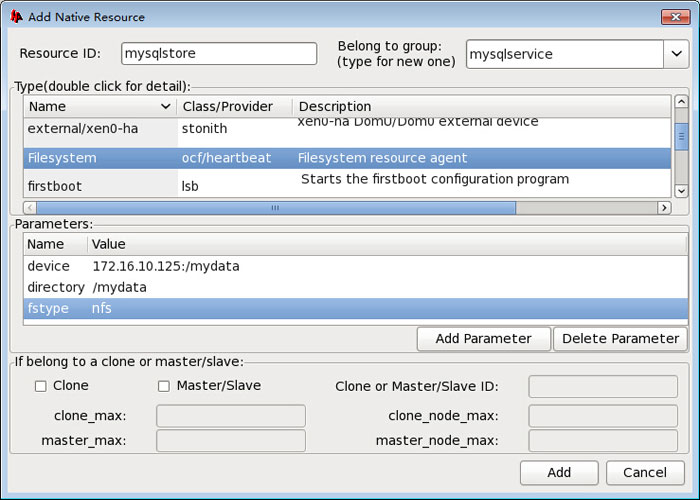

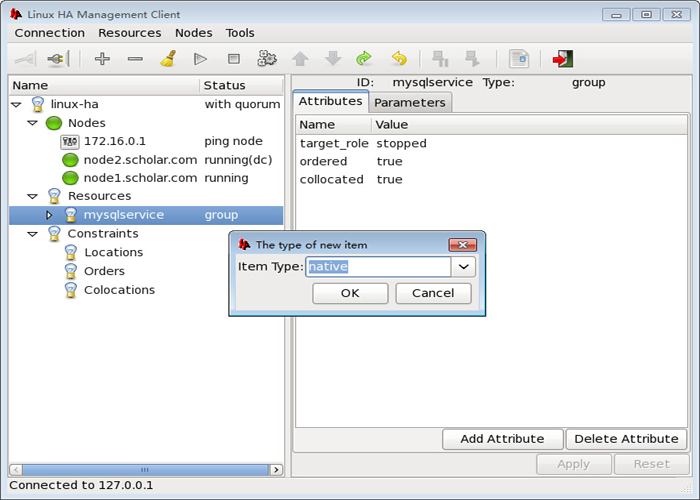

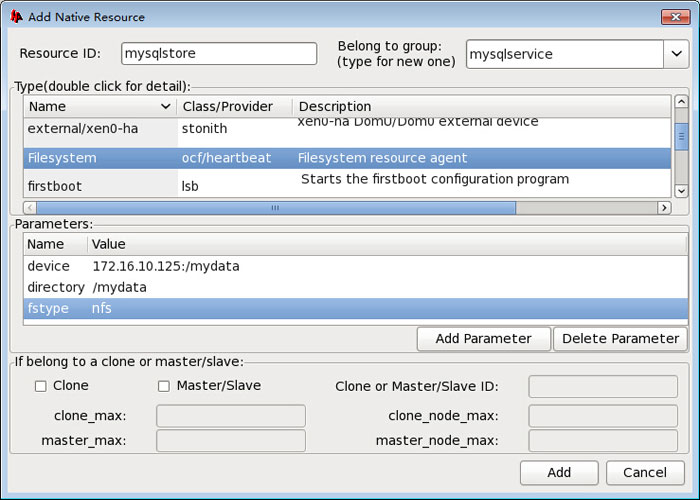

添加第二个资源

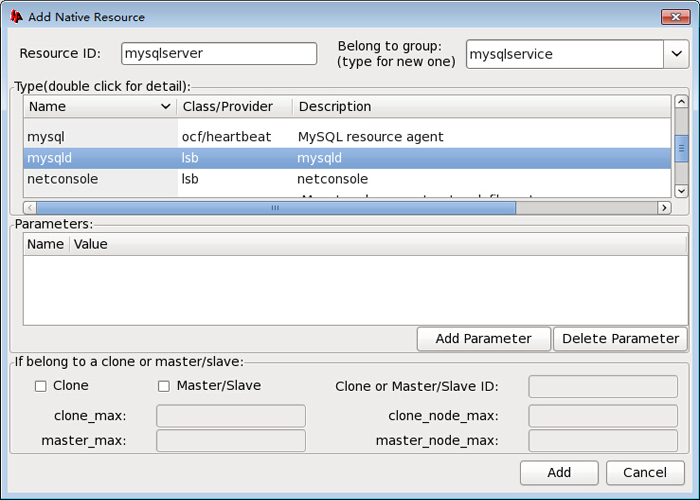

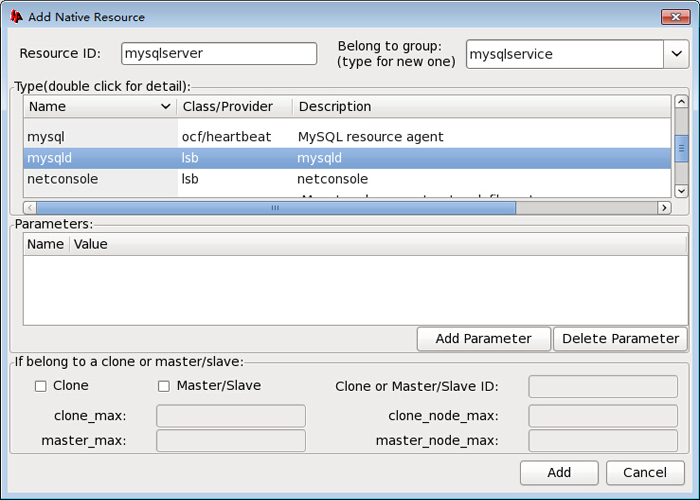

添加第三个资源

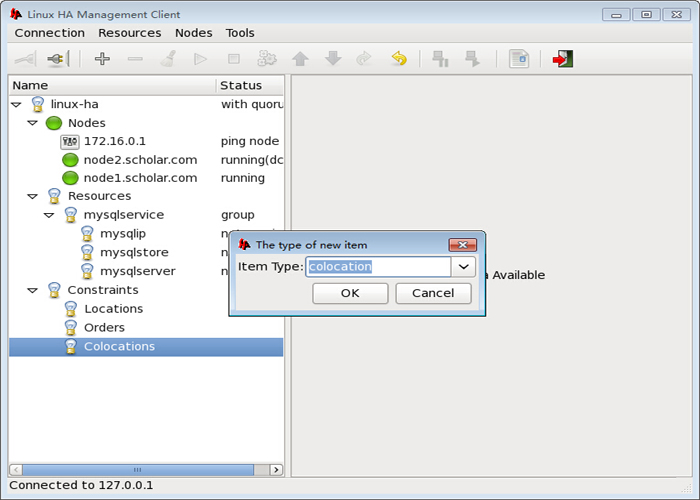

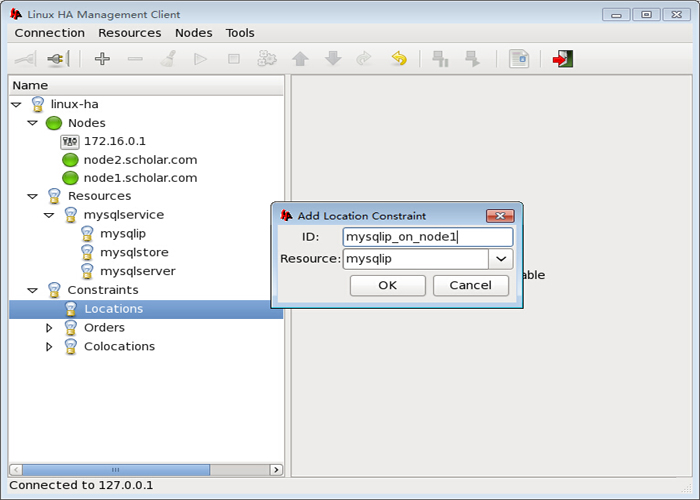

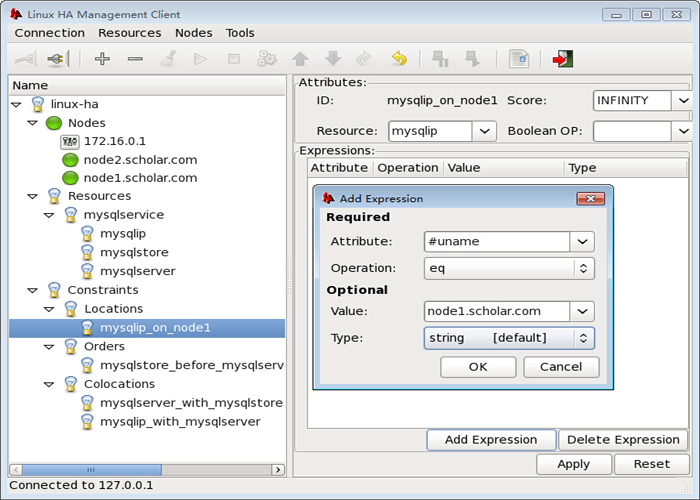

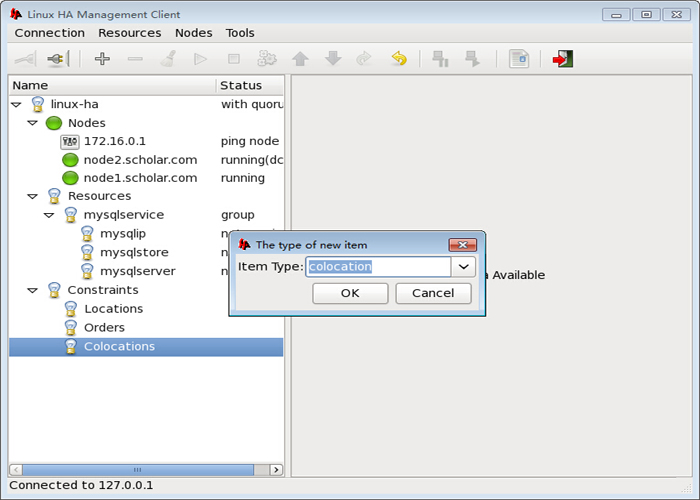

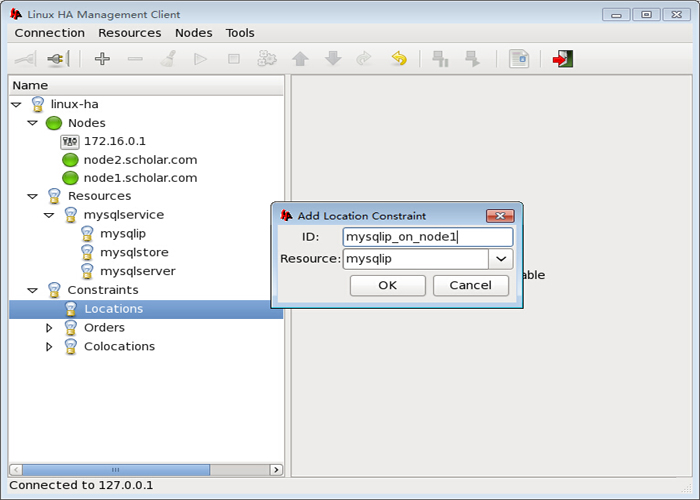

添加资源约束

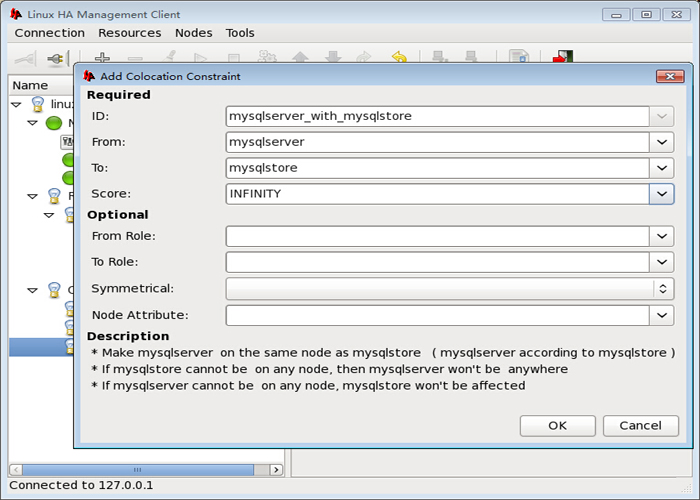

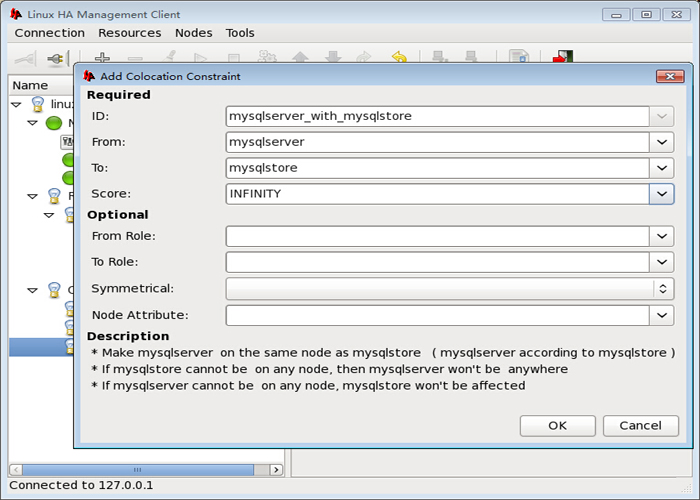

nfs要和mysqld在一个节点

ip要和mysqld在一个节点

定义排列约束后这3个资源会同时运行在同一个节点上,需要注意的是mysqld服务要在nfs挂载之后启动,所以需要定义资源顺序约束

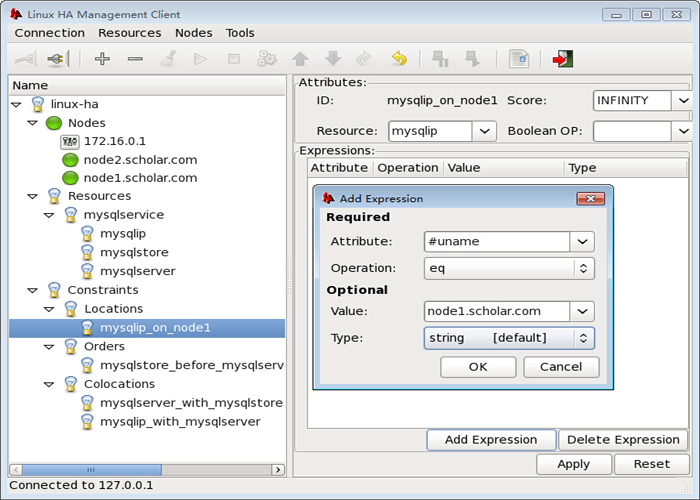

定义好顺序约束之后还可定义位置约束,可定义更倾向运行在哪个节点

添加表达式及对该节点的倾向性

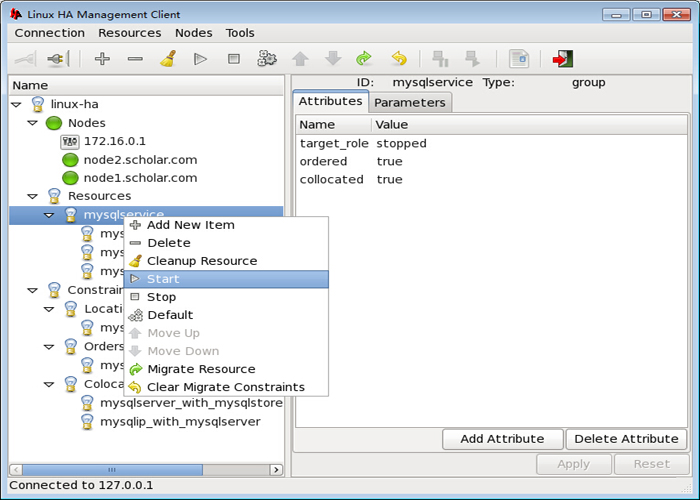

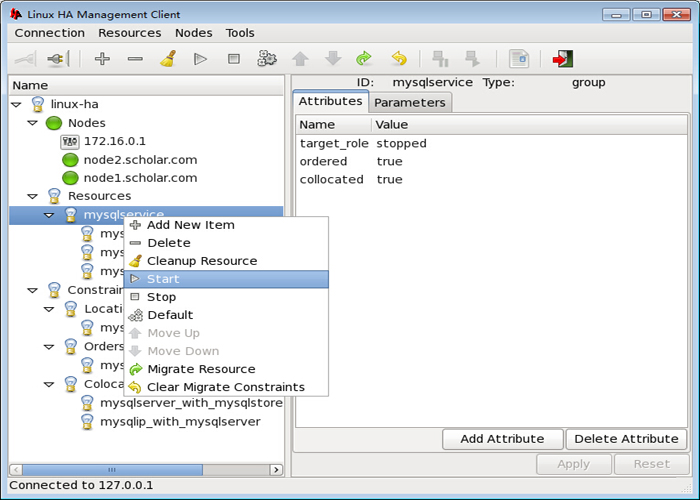

启动所有资源

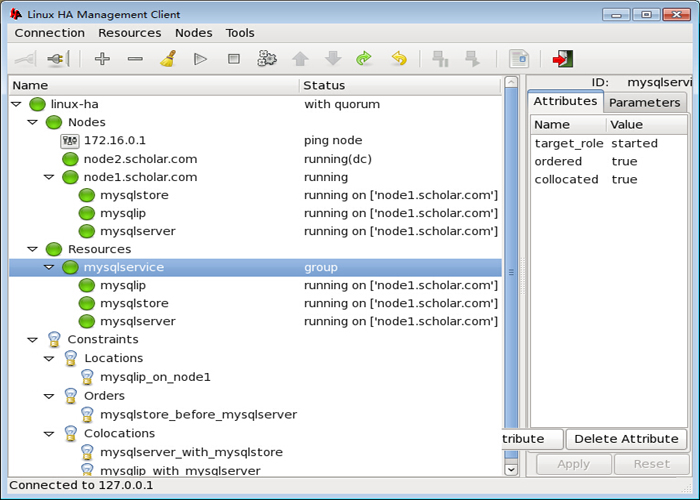

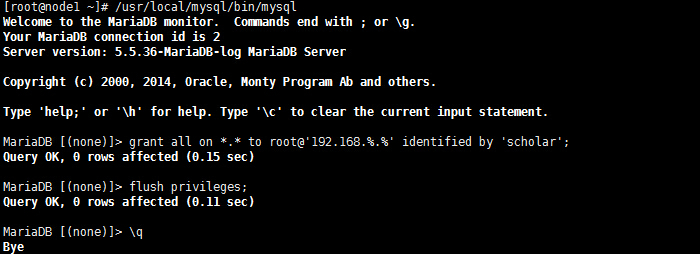

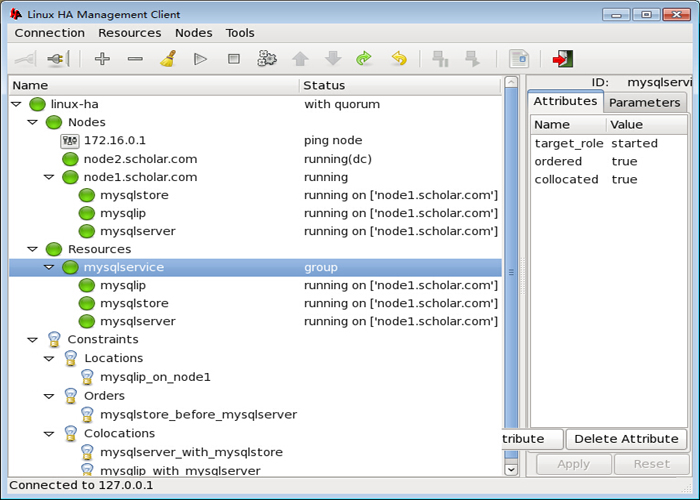

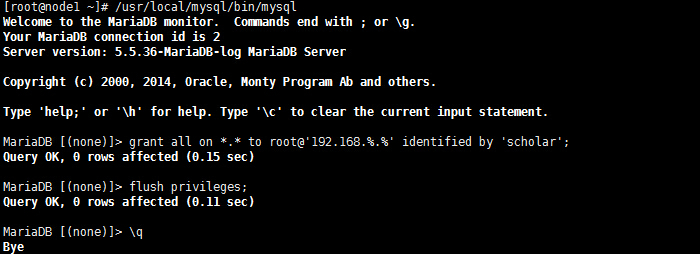

因为倾向于node1,所以资源运行于node1上,我们在node1授权一个用户测试

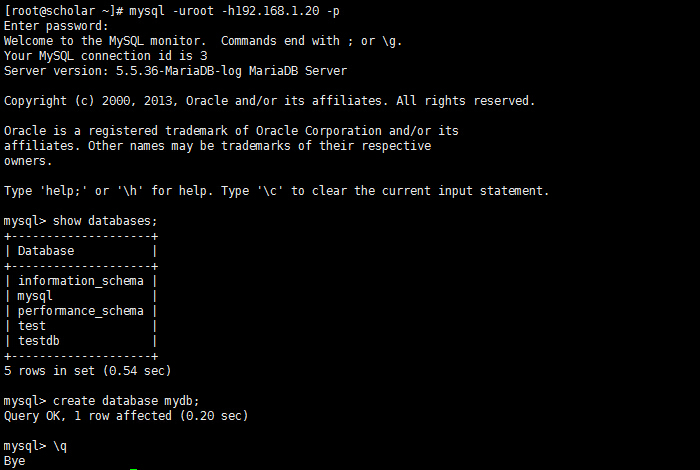

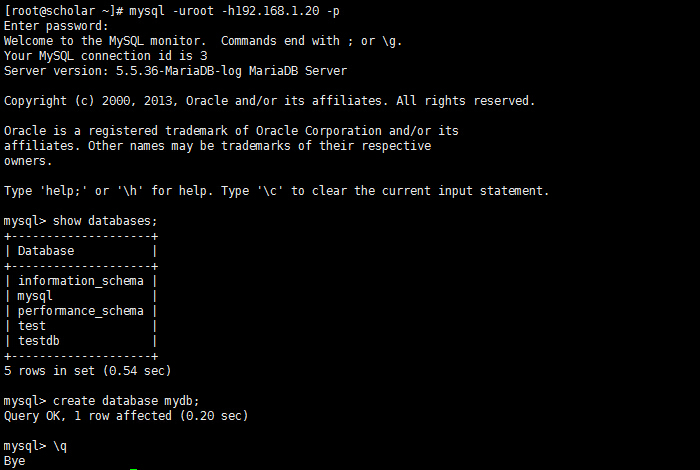

在其他客户端测试

此时模拟node1挂掉了,将node1设置为standby模式

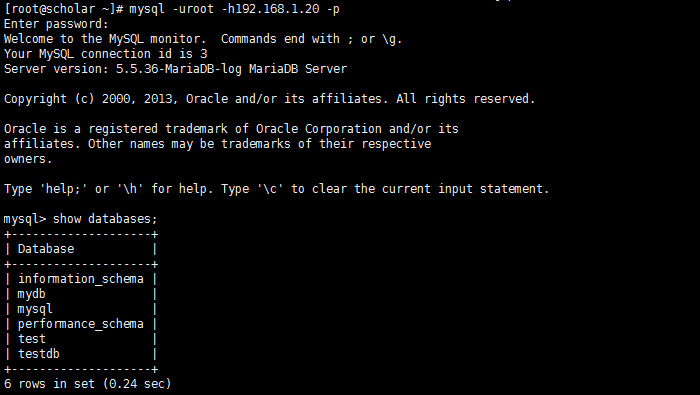

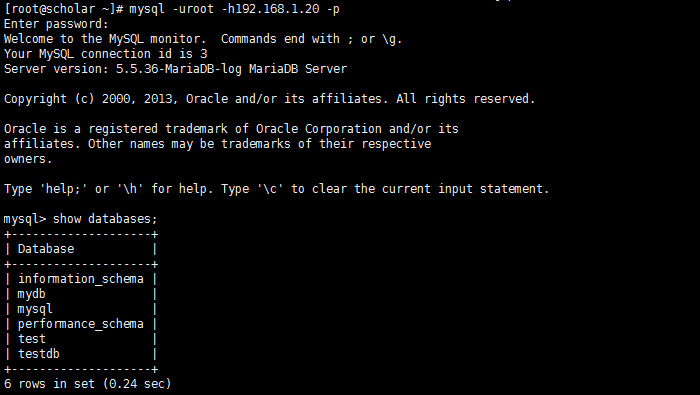

再次连接数据库测试

数据没有受到丝毫影响,再次将node1上线,资源会再次回到node1,这里就不再演示了,至此,基于heartbeat v2 crm实现基于nfs的mysql高可用集群完成

|